Nouvelles cartes Nvidia RTX 2080 et RTX 2080Ti : les clés pour se décider

Voilà, les nouvelles cartes Nvidia sont maintenant « officiellement » là. Si le sujet vous intéresse vous avez sans doute été abreuvé des sempiternelles pages de benchs multiples et variées. Je ne couperai pas à cet exercice prochainement, mais il ne comporte pas pour moi de véritable intérêt dans ce petit article dont l’unique vocation est de vous éclairer dans vos choix.

Si l’overdose de chiffres est une passion pour vous, je vous laisse consulter l’ensemble des autres sites de hardware qui disent globalement la même chose. En revanche, si vous souhaitez vous faire un avis rapide sur quelques points précis, c’est ici que ça se passe !

Les cartes Nvidia RTX 2080 et 2080Ti sont-elles vraiment révolutionnaires ?

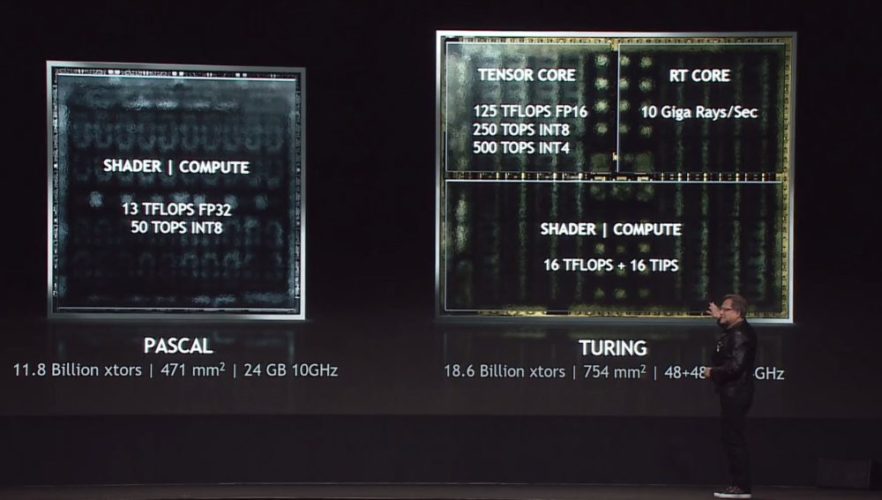

Le terme « révolutionnaire » a tellement été dévoyé par certains fabricants de téléphones que je suis toujours hésitant à l’employer. On peut cependant parler sans conteste d’une vraie rupture avec l’arrivée du GPU Turing. Outre un GPU massif et bien plus imposant que la génération précédente (malgré un passage à la gravure 12 nm) c’est surtout le changement profond d’architecture qui impressionne. En effet, Turing introduit ainsi une nouvelle manière de répartir les calculs. Pour faire simple, sur Pascal (GTX 10xx), les calculs étaient réalisés à la chaîne, sur Turing, il est maintenant possible de paralléliser un certain nombre d’opérations. Pour favoriser cette parallélisation, un nouveau système de cache est embarqué.

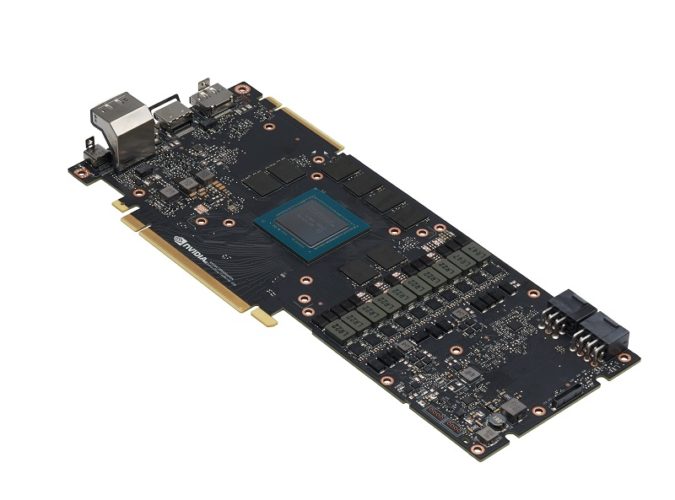

Mais au delà de cette « nouvelle méthode de calcul », il convient surtout de parler des nouvelles unités Tensor Core, destinées au deep learning et à l’intelligence artificielle. Directement héritées de Volta, ces unités devaient répondre à des besoins spécifiques aux serveurs ; pour Turing, elles seront entre autres affectées au traitement de l’image. Il faut ajouter à cela quatre unités dédiées aux textures et une unité de calcul RT Core (Ray Tracing). Bref, nous comprenons facilement pourquoi le GPU d’une RTX 2080 fait quasiment deux fois la taille de celui d’une GTX 1080. Concernant l’architecture, nous pouvons aussi ajouter une masse considérable d’optimisations permettant d’utiliser la puissance et de limiter les goulets d’étranglement.

Bref, c’est bien simple, au delà de la conception du GPU, la liste de nouveaux outils destinés à améliorer le rendu, la lecture vidéo, la fluidité et autres est tout bonnement impressionnante.

Le saut de performances procuré par les nouvelles RTX est-il conséquent ?

C’est clairement LA question piège… et il est difficile d’y répondre de manière tranchée.

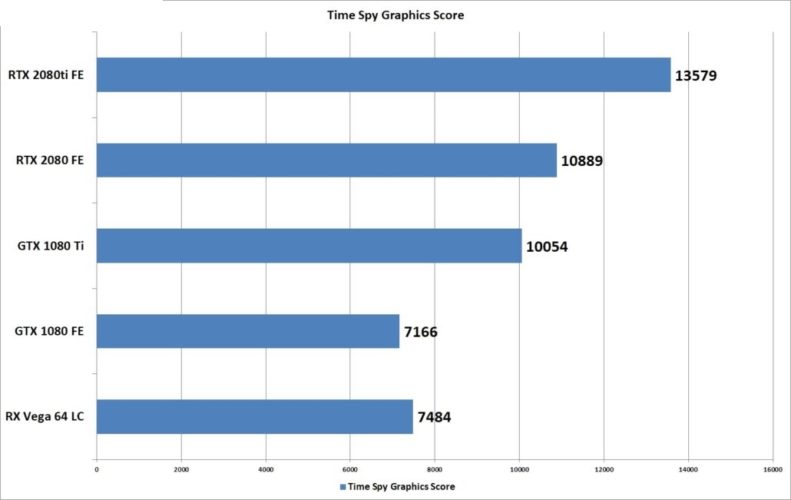

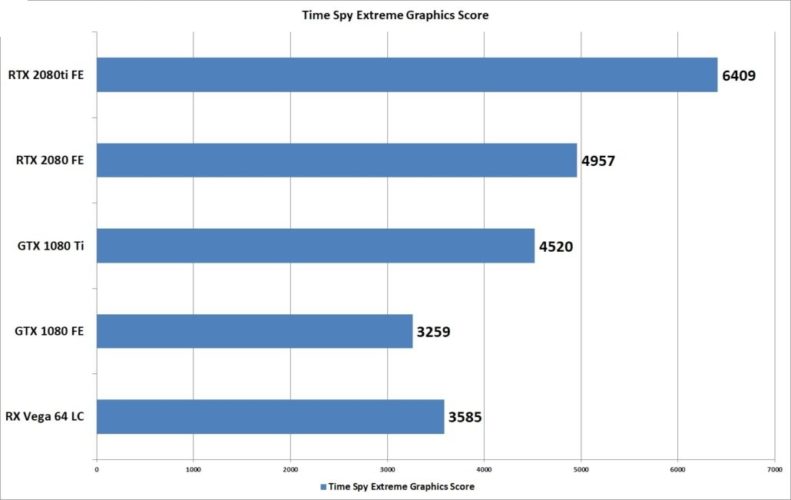

Soyons pragmatiques : La RTX 2080 que nous avons entre les mains est supérieure dans tous les domaines à une GTX 1080Ti (pour le RTX 2080 comme pour la GTX 1080Ti, nous avons utilisé une version custom de la carte de marque EVGA). Cependant, les écarts sont faibles et difficilement perceptibles mis à part sur certains titres particulièrement optimisés pour la nouvelle venue. Néanmoins, la RTX dispose d’un potentiel d’évolution que n’aura plus la 1080Ti. Le bagage de technologies embarqué sur la RTX n’est actuellement que très partiellement utilisé dans les protocoles de tests et les jeux du moment. Compte tenu du poids de Nvidia sur le secteur mais aussi de l’arrivée du Ray Tracing au sein de l’API Microsoft, il ne fait aucun doute que les éditeurs vont s’approprier progressivement cette puissance et ces nouveaux outils.

Quelques benchs pour se faire une idée sans se noyer…

J’envisage l’achat d’un nouveau PC, dois-je impérativement basculer sur du RTX ?

C’est évidemment une question de budget. Si votre objectif et de vous monter un PC au dessus de 2000 €, la réponse est oui sans hésitation. La RTX 2080, et encore plus la RTX 2080Ti, donne des gages pour l’avenir que ne peuvent plus assumer une 1080 ou une 1080Ti. Néanmoins, une configuration en RTX nécessitera encore plus d’attention qu’une machine à base de GPU Pascal. La nouvelle puce Nvidia est plus gourmande et elle réclame un CPU performant. Ce sont autant d’éléments à bien considérer dans la conception de votre future machine.

Pour les budgets entre 1000 et 1900€ il n’y a pas de débat. Même si la RTX 2070 doit arriver, certaines GTX subsisteront au delà de 2018, Nvidia l’a confirmé. Une GTX 1080Ti, une 1070Ti et une 1060 pourront alors disposer de l’argument prix déterminant dans un contexte où la conception d’une machine va devenir un sport difficile dans les prochaines semaines.

Dois-je jeter ma GTX 1080Ti pour basculer sur de la RTX ?

Clairement non, comme je l’ai dit plus haut, en l’état, les différences de performances entre une 1080Ti et une RTX 2080 sont relativement faibles. Evidemment, le delta est en revanche beaucoup plus important si on considère une RTX 2080Ti. Au-delà de l’argument du budget, il faudra considérer aussi sa façon d’utiliser son PC (et de jouer évidemment). Si vous êtes fortunés, que vous jouez en 1440p et envisagez un 4K haut de gamme : alors oui, le saut vers une 2080Ti se justifiera sur le terrain des performances. Je vous laisse avec votre conscience (et votre banquier) concernant la justification financière.

Il faudra aussi considérer les incertitudes sur les prix, la situation sur les 6 prochains mois n’incitant pas vraiment à un pronostique sur une baisse des prix.

Le Ray Tracing va t-il devenir incontournable ?

C’est un pari. Mais Nvidia n’est pas le seul puisque cette technologie est clairement supportée par Microsoft au travers de DirectX12. Dans cette démarche, Nvidia choisit aussi de privilégier le rendu et le réalisme; voilà pourquoi il est difficile, à cet instant, d’en mesurer totalement l’impact ainsi que le potentiel de ces nouvelles cartes.

D’autre part, à raisonner uniquement en vitesse de traitement, en puissance brute, il ne faut pas être un génie pour comprendre que nous avions atteint un plafond. Il y a encore quelques temps, nous tenions un débat sur le sujet « de nouveaux GPU pourquoi faire ? ». La génération Pascal continue à s’acquitter avec application de toutes les tâches gaming; seul un petit noyau d’utilisateurs extrêmes et sur-équipés peuvent se sentir bridés en 4K, 1440p ou sur de hautes fréquences… Dans ces conditions et en l’absence d’une concurrence vraiment dangereuse, Nvidia pouvait allègrement se contenter d’un refresh. Ils en ont décidé autrement.

Nvidia abuse t-il ?

Nous venons de sortir d’une séquence complexe où le minage des crypto-monnaies a engendré une spéculation inédite poussant à la hausse le prix des cartes graphiques. Beaucoup en ont profité, sans aucun doute Nvidia en a pris sa part. Il ne faut pas s’arrêter à ça pour généraliser. Nvidia est en position dominante sur le marché des cartes graphiques. Il le doit à une concurrence faiblarde mais surtout à la qualité de ces produits. Je l’ai dit plus haut, compte tenu de l’état de cette concurrence et de la bonne tenue de sa génération Pascal, il aurait suffit d’un bon vieux refresh à Nvidia pour continuer sa domination pendant encore quelques longs mois. Le caméléon en a décidé autrement.

La quantité de technologies injectée par Nvidia dans ses RTX est considérable. Si beaucoup de choses sont difficilement palpables à cet instant, c’est un vrai risque qu’a pris l’entreprise. Il faut bien avoir conscience que toutes ces technologies sont portées par Nvidia et Nvidia seul. Qui peut se targuer d’investir autant dans le gaming PC aujourd’hui ? Alors oui, la génération Turing est chère mais elle le doit à un effort de recherche et développement conséquent que ne font plus les autres (par confort pour certains, par manque de moyen pour d’autres). La taille du GPU et le nombre de transistors devraient déjà apporter une réponse aux plus sceptiques : l’évolution est énorme.

Turing est un pari sur l’avenir mais surtout un pari sur le PC tout court et en cela, il faut voir au delà du prix. Sans ce type de pari le #PCMR existerait-il encore aujourd’hui face aux consoles ?

Du coup je me demande si une 2080 ti sera pleinement exploitée avec genre un processeur i7 6700K? Y a pas un risque de bridage?

Un i7-6700K risque d’être trop léger pour une RTX 2080 Ti. Comme dit dans l’article les nouveaux GPU demandent un CPU performant, et il faudrait regarder plutôt du côté des 8700K je pense.

Il serait dommage de prendre une si belle carte mais que le reste ne suive pas.

Serait-il possible d’avoir un comparatif de performance avec d’ancien CPU pour vérifier s’il y a un bottleneck par rapport à la carte graphique ?

J’ai un i7 3770 avec une 1080Ti et je ne suis pas très loin des scores des derniers CPU en termes de FPS moyen sur cette carte graphique.

Je ne comprend pas vous parler de benchs avec une 2080 EVGA, mais les graphs sont sur les Founders Edition et vos graphs sont en anglais. Et faire du 3D mark pour donner un avis sur une carte à ce prix, c’est plus que léger…

Le graph est donné en exemple pour les ratios, j’ai dit clairement qu’un article plus détaillé arriverait après. L’idée de ces 2 graphs c’est de montrer le faible écart. Si vous cherchez des benchs, vous savez bien que tous les autres le font. J’ai essayé une approche différente.

En fait NVIDIA à enfin introduit les ACE de GCN à sa sauce.

Il était temps: DX12 et Vulkan vont enfin pouvoir se démocratiser.